På Yuma Test Grounds i Arizonas öken samlades en gång en grupp ledda av Mark Tilden från Los Alamos National Laboratory tillsammans med en delegation från det amerikanska försvaret. Syftet var det första fullskaliga testet av en ny minröjarrobot. Roboten var designad med flera insektsliknade ben och skulle nu röja ett skarpt minfält för första gången. Den fungerade genom att leta sig fram till nedgrävda minor och sen detonera dem genom att helt enkelt kliva på dem. Efter att ha blivit sprängd reste den sig igen och fortsatte på sina kvarstående ben. När den närmade sig slutet av minfältet sägs den arméöverste som övervakade testerna ha bränt en mental säkring och ropat att testet skulle avbrytas. Roboten drog sig vid tidpunkten bokstavligen fram med sitt sista ben. Tilden var extatisk att hans robot presterade precis som den skulle och ställde sig frågande till överstens oväntade reaktion. Testet var inhumant, invände översten, som inte kunde stå ut med synen av den brända, ärrade och lemlästade roboten som drog sig fram på sitt sista ben.

Människan har alltid strävat efter att strida på så långa avstånd som möjligt och att reducera den risk vi själva utsätter oss för. Som en del i denna strävan har våra vapensystem kontinuerligt blivit bättre men även utvecklats att klara sig allt mer själva utan mänsklig inblandning, vad vi brukar kalla autonoma vapensystem.

Denna utveckling har drivits både av nödvändighet och säkerhet. Exempelvis har luftförsvarssystem utvecklats mot autonomi eftersom de kan bedöma, prioritera och verkställa bekämpning av multipla inkommande hot snabbare och effektivare än en människa kan. De löser uppgifter med en komplexitet som människor svårligen skulle kunna bemästra. Utöver det har autonoma system utvecklats för att sköta vad man brukar kalla de tre D:na – Dull, Dirty & Dangerous. I militära exempel kan det handla om övervakning där den mänskliga vaktposten sannolikt hade blivit uttråkad och slarvig eller minröjning där risken mot en mänsklig ammunitionsröjare kan reduceras eller elimineras.

Det finns två centrala aspekter runt att förstå autonomi. Det första är att det är en skala och inte ett digitalt förhållande. Alla system vi skapar för att komplettera mänsklig kognition får den grad av autonomi vi ger eller programmerar det att ha. Från fjärrstyrd, till halvautonom eller full autonomi – robotar som kan avgöra vad de ska göra härnäst utan mänsklig inblandning. Det andra är att full autonomi inte är detsamma som mänsklig autonomi. En fullt autonom robot kan agera och fortsätta agera utifrån hur den blivit programmerad. I militära sammanhang kan det innebära att genomföra en bekämpning för att sen fortsätta att genomföra nästa utan mänsklig inblandning. Men den är trots det inte fullt autonom som vi människor. Den vaknade inte i hangaren, tog en morgonkaffe och bestämde sig sedan för att åka ut och döda någon – det fanns en programmerare som talade om för den hur den skulle agera. Den landar heller inte efter ett uppdrag en dag och beslutar att den fått nog av det militära livet och vill byta jobb eller pensionera sig i en hangar på landet och leva lugnt tillsammans med sin älskade drönar-partner. En fri vilja och ett medvetande saknas och robotar gör ännu ingenting som en människa inte programmerat dem att göra.

Våra diskussioner inom området påverkas ofta av dystopiska framtidsvisioner från filmer som Terminator och iRobot där robotar med artificiell intelligens når självmedvetande och beslutar sig för att döda människorna som skapade dem. Men den spekulativ framtida tekniska tidpunkt där maskiner når punkten att de kan börja vidareutveckla sig själva, vad som brukar kallas för singularitet eller ”strong AI”, är ännu en hypotetisk punkt och vad som händer då förblir spekulativa diskussioner.

En mer närstående fråga är runt programmeringen av autonoma vapensystem. Om vi kan acceptera att självkörande bilar kan följa trafikreglerna bättre än en människa, borde inte autonoma vapensystem kunna följa krigets lagar bättre på stridsfältet? Svaren har varit delade. En del har menat att människor på slagfältet vet när de ska bryta order och inte bekämpa någon, medan ett autonomt system skulle fortsätta att döda som det var programmerat att göra. Andra menar tvärtom att autonoma system skulle genomföra den bekämpning som krävdes med större precision och utan att skada fler än den programmerats till. Problemet med vår mänskliga moral är att vi inte alltid följer den utan tvärtom är väldigt duktiga på att anpassa den för att passa våra syften eller rationalisera beteenden i en given situation. Begreppet ”mänsklighet” är heller inte på något sätt en gyllene standard för bra beslut. Det är tvärtom ofta de mörkare sidorna av begreppet som ilska, frustration, utmattning, avtrubbning och hämndbegär – inte bristen på moraliska principer – som leder till övergrepp och krigsbrott på slagfältet. Ronald Arkin går ett steg längre och menar att drönare, just på grund av att de saknar personligt egenintresse och anlag för överdriven grymhet mot sina motståndare, i själva verket vore mer etiska än människor i krigföring. ”Jag kommer aldrig, aldrig hävda att dessa system kommer att bli perfekta”, menar han, ”men jag hävdar däremot att dessa system kan prestera bättre än människor på stridsfältet ur ett etiskt perspektiv.”

Potentiella dilemman utan svar är dock inte svåra att hitta, och flera brukar återupprepas i diskussioner om autonoma system. Om en självkörande bil möter två uppdykande personer och omöjligt kan väja för båda vem ska den då köra på, den lilla flickan eller den äldre farbrorn med rullator? Om ett autonomt vapensystem upptäcker en minderårig pojke som är på väg att förvarna fienden via radio, ska det då bekämpa denne för att rädda liv i den egna styrkan? Tekniska system skulle få svårt att besluta i dessa fall, men det skulle ärligt talat de flesta människor också.

Scenarierna är väldigt lika Philippa Foots klassiska etiska dilemma The Trolley Problem. Dilemmat rör hur vi som människor ser på beslut om att ta liv och är ett exempel som återkommer inom praktisk filosofi: Du ser en skenande tågvagn komma farande längs rälsen, längre fram står fem personer. Du har inte möjlighet att varna dem men du har alternativet att växla in tåget på ett stickspår där bara en person står. Drar du i växelspaken? De flesta skulle svara ja, att offra en för att rädda fem går i linje med den utilitaristiska tanken att moralen i en handling utgår från dess effekter: Att offra en låter då rimligt. Men föreställ dig sen i ett modifierat scenario att du står på en bro över järnvägen och har möjlighet att knuffa en väldigt tjock man ner på rälsen där hans kroppshydda skulle stoppa tågvagnen. Skulle du knuffa honom? Här svarar de flesta nej trots att effekten skulle vara densamma: Att offra en för att rädda fem. Den deontologiska tanken att moralen i en handling utgår från regler, som att det är fel att döda oskyldiga oaktat förutsättningar, blir här mer styrande. Vårt mänskliga sätt att psykologiskt resonera runt etiska dilemman är inte alltid konsekvent eller logiskt.

Det klassiska filosofiska tankeexemplet illustrerar en krock mellan utilitarism och deontologiskt tänkande i vad som är rätt och fel rörande att ta liv. Jag kommer inte påstå mig ha någon given lösning på problemet mer än tanken att om våra mest framstående filosofer inte kan komma överens om enade ”lagar” för vad som är det etiskt och moraliskt rätt för en människa att göra i en sådan situation, är det då inte lite för mycket begärt att kräva att autonoma system vi själva programmerat ska kunna fatta samma beslut på något sätt som är ”mänskligt” bättre?

Humanisering av inanimata objekt

En betydande del i att diskussioner ofta leder fel har varit humaniseringen av inanimata (ej levande) objekt, exempelvis genom attribut som ”mördar-robotar”. Att vi humaniserar tekniska system är i sig logiskt. Det blir en förlängning av att robotar övertar eller kompletterar mänsklig kognition. Processen för detta brukar kallas för antropomorfism och syftar på när vi tillskriver karaktär, personlighet eller andra mänskliga kvalitéer till ett objekt.

En medveten humanisering kan ses i vapenmotståndarnas kampanjer genom nyttjande av begrepp som ”mördar-robotar”. Att humanisera ett tekniskt system gör att vi förskjuter mänskligt uppsåt och avsikt till ett objekt vilket gör det lättare att fördöma. Det är svårt att skapa skräck för ett kretskort, men alla är rädda för en mördare. Avsikt och uppsåt är dock inneboende mänskliga kvalitéer och med humaniserande argument riskerar vi att fördöma tekniska plattformar istället för de antagonister som programmerar eller använder dem. I vissa fall har humaniseringen gått så långt att den helt skiftat om rollerna och i flera uppmärksammade fall har drönare utmålats som antagonister samtidigt som dess piloter tillåtits ta en offer-roll.

Det kanske tydligaste exemplet har varit den ”avhoppade” drönarpiloten Brandon Bryant som intervjuats frekvent av internationella medier, men även av svenska medier som Kalla Fakta (Sverige och drönarkriget) samt SVT:s Dokument Utifrån (Död på distans). I dessa har han beskrivit hur han verkställt bekämpningar av mål där han såg att kvinnor och barn fanns närvarande samt att han nådde rekord bland drönarpiloterna genom att döda 1626 människor. Med detta som grund har drönarna ifrågasatts som vapensystem och flygvapnet kritiseras för att inte ta piloternas psykiska hälsa på allvar. Jag ifrågasätter inte på något sätt hans psykiska ohälsa. Men det finns två ytterligare frågor vi bör fråga oss. Finns det någon som inte skulle må dåligt efter att ha dödat 1626 människor, och skulle Bryant ha haft en bättre hälsa om han dödat dem med ett prickskyttegevär istället för drönare? Svaret är sannolikt att den psykiska ohälsan är generisk med handlingen att döda och med respekt för distanslagen fortfarande relativt oberoende val av vapenplattform. Den andra aspekten är att han själv erkänner att han (inte ”mördar”-drönaren) verkställt folkrättsvidriga bekämpningar av kvinnor och barn. Ändå har det humaniserade systemet, inte hans användande av det, ifrågasatts som ”omoraliskt”. Drönarpiloten har inte bara getts moralisk ansvarsfrihet utan även tillåtits ta en offerroll där det humaniserade tekniska vapensystemet skuldbelagts för att ha orsakat dennes psykiska ohälsa.

Bra forskning har hunnit komma när det gäller psykologiska effekter på drönarpiloter och hur vi reagerar på distribuerat eller distanserat dödande. Den visar sammantaget att belastningen på piloter som dödar med autonoma system är i grovt jämförbar (i flera studier något mindre) än för piloter av bemannade flygplan och generellt lägre än för markförband som verkat inom samma område. Dock så har de haft en högre förekomst av icke-traumatiska stressreaktioner som följd av arbetsrelaterad stress (t.ex. utmattning, utbrändhet, cynism…) orsakad av dåliga arbetsförhållanden, långa arbetsdagar, oklar befälsstruktur eller otydliga befordringsvägar. Den tekniska utvecklingen har omsatts snabbare än vad organisationerna hunnit anpassa sig.

Det som även förekommit har varit en tydlig dissociation; ett undvikande tillstånd där individer inte kunnat hantera de skarpa kontrasterna mellan att genomföra insatser i en krigszon för att sedan åka hem till familjen i ett land i fred utan möjlighet att ”tryckutjämna” eller att kunna prata med någon om vad man varit med om. Ethan Hawke exemplifierade detta fenomen väl i filmen Good Kill då han svarar på snabbköpsexpeditens fråga om han någon gång kämpat i ett krig: ”I blew away six Taliban in Pakistan today, now I’m going home to barbeque”.

Gruppen Ban Lethal Autonomous Weapons har gått steget bortom ”murder” med sin film ”Slaughterbots”. Filmen målar upp ett oerhört skrämmande scenario med ett terroristangrepp på ett universitet och kongressen samt ställer frågor vad som kan ske om ’slakt-robotar’ släpps lös att bekämpa människor riktat utifrån etnicitet eller politisk tillhörighet. Filmen visar otäcka vapen i ett skräckinjagande scenario. Om det råder ingen tvekan. Men det som dock berörs mycket mindre är antagonisterna bakom. Att människor med onda avsikter kan uppnå större skada med mer kraftfulla vapen är sannolikt de flesta eniga om. Effektiva vapensystem i händerna på fel personer kommer att leda till att oskyldiga dör. Men tror vi att uppsåtet hos antagonisterna uppstod när de fick tillgång till vapnen, eller att ett förbud hade förhindrat ett attentat? Sannolikt blir svaret att en väl utbildad, organiserad och finansierad terroristgrupp med uppsåt och avsikt att mörda riktat utifrån etnicitet eller politisk tillhörighet är en oerhörd fara för samhället helt oaktat vilka vapen de förfogar över. Även om vissa vapensystem är mer kraftfulla än andra hade jag personligen varit mycket mer rädd för terroristgruppen än det tekniska system de hypotetiskt skulle kunna komma att använda.

Individer i det militära systemet är ärligt talat också ganska duktiga på att själva vilja se sina vapensystem som lite mänskliga, genom något så grundläggande som att ge dem namn eller målningar för att tillföra mänskliga attribut. En intern humanisering sker naturligt för att relatera till föremål som vi är beroende av för vår egen trygghet. Peter W Singer berör i sin bok Wired for War flera exempel på soldater som inte bara gett robotar namn utan även grader och utmärkelser efter svåra uppdrag. Han beskriver även tillfällen när roboten blivit en så naturlig del av gruppen att soldater riskerat sina egna liv för att under beskjutning ”rädda” den när den skadats av den mina den hade till uppgift att röja. Under yttre hot tenderar vårt beroende av och därmed förmågan att empatiskt knyta an till objekt att öka. Den interna humaniseringen kan ses även i namnval. MQ9-drönare har exempelvis getts namnet Reaper – döden personifierad. Om detta varit en bidragande orsak till, eller konsekvens av att vapentypen kallats för ”Killer-drones” är oklart. Men med ett vapensystem som är namngiven efter döden personifierad blir det inte konstigt att vi tillskriver det mänskliga attribut.

En ytterligare negativ aspekt med att humanisera sakfrågor är att det gör diskussionen emotionellt laddad och svår, för att inte säga omöjlig, att föra vidare rationellt. Som Linda Johansson så väl påpekar i sin bok Äkta robotar så kan en diskussion om fördelar i olika kostalternativ vara fullt rimlig. Men den vegetarian som benämner maten för mordoffer, köttätare för mördare och ställer dem ansvariga att förklara sitt vidriga beteende kommer sannolikt inte att nå särskilt långt i sina försök att övertyga. Att humanisera det som inte är mänskligt kan leda oss fel på mer än ett sätt.

”The uncanny valley”

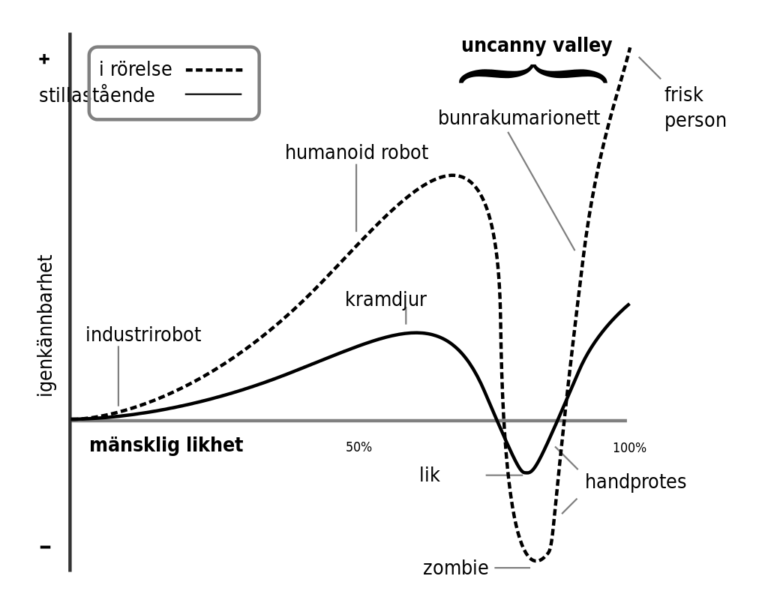

En del av förklaringen i varför vi blir så rädda när autonoma system når en viss grad av humanisering kan förklaras av det som inom psykologin kallas ”The uncanny valley” eller den obehagliga dalen. Vår tendens att empatiskt knyta an till ett objekt ökar generellt med graden av human likhet – ju mer lik en människa (kognitivt eller utseendemässigt) desto starkare anknytning. Men vid en viss punkt när något är nästan mänskligt (Uncanny resemblance) tenderar effekten att bli omvänd och tvärtom övergå i rädsla eller avsky. Detta har setts inte minst inom film och animation där användandet av för människoliknande figurer inte bara leder till utebliven empatisk anknytning mellan tittare och karaktär, utan tvärtom leder till en negativ effekt där tittare upplevt obehag.

En del i förklaringen tros ligga i vår oförmåga att förena olika tillstånd; når något är slående mänskligt på ett sätt men inte på ett annat verkar vår hjärna oförmögen att förena de två tillstånden och reagerar med avsky snarare än empatisk anknytning. Modellen är självklart en grov förenkling och någon konsensus för orsaken saknas i forskningen. Men fenomenet understryker att vårt sätt att knyta an till objekt varken är logiskt eller linjärt.

Behovet av kontroll

En aspekt som ofta underskattas eller utelämnas i diskussioner om framtida nyttjande av autonoma vapensystem är människans behov av överblick och kontroll. Människor vill känna att de kan korrekt uppfatta men även påverka en situation som ligger framför dem. I krig och konflikt med stora inslag av friktion, osäkerhet och risk blir detta behov än större. Att den tekniska utvecklingen möjliggör att en militär befälhavare kan lämna ifrån sig kontrollen till autonoma vapensystem är absolut inte samma sak som att denne vill göra det. Kritiker som varnar att människan kommer ersättas av robotarméer har gravt underskattat det mänskliga behovet av överblick och kontroll. Så länge det är ett mänskligt val att gå i krig och så länge människor kommer att påverkas av dess effekter är det högst sannolikt att människor kommer att vilja fortsätta kontrollera beslut om liv och död på stridsfältet.

Författaren är major, doktorand i psykologi och ledamot av KKrVA

Referenser och vidare läsning:

Arkin R (2009) Governing Lethal Behavior in Autonomous Robots, CRC Press

Bergman, D. (2016) The Humanization of Drones: Psychological Implications on the Use of Lethal Autonomous Weapon Systems. In: Custers B. (eds) The Future of Drone Use. Information Technology and Law Series, vol 27. T.M.C. Asser

Bergman, D. (2015) Myten om de omoraliska drönarna – Hur autonoma vapensystem kan leda till högre moral i krigföring, Kungl. Krigsvetenskapsakademiens Handlingar & Tidskrift, 4/2015

Chappelle, W.; McDonald, K; Thompson, B. & Swearengen, J. (2012) Prevalence of High Emotional Distress and Symptoms of Post-Traumatic Stress Disorder in U.S. Air Force Active Duty Remotely Piloted Aircraft Operators, Technical Report AFRL-SA-WP-TR-2013-0002, Wright-Patterson AFB, U.S. Air Force School of Aerospace Medicine

Chappelle, W.; McDonald, K.; Prince, L.; Goodman, T.; Ray-Sannerud, B. N. & Thompson, W. (2014) Symptoms of Psychological Distress and Post-Traumatic Stress Disorder in United States Air Force “Drone” Operators, Military Medicine, 179, 8:63

Chappelle, W.; McDonald, K. & King, R. E. (2010) Psychological attributes critical to the performance of MQ-1 predator and MQ-9 reaper US air force sensor operators. Air Force Research Labs Technical Report AFRL-SA-BR-TR-2010-0007. Brooks City-Base, TX: Air Force Research Laboratory

Johansson, L. (2013) Autonomous Systems in Society and War: Philosophical Inquiries, Royal Institute of Technology, Stockholm

Johansson, L. (2015) Äkta robotar, Fri Tanke

Singer, P. W. (2009) Wired for war – The Robotics Revolution and the 21st Century Conflict. New York, Penguin Press

Tvaryanas, A. P. (2006) The development of empirically-based medical standards for large and weaponized unmanned aircraft system pilots. USAF 311th Human SystemsWing Technical Report HSW-PE-BR-TR-2006-0004. Brooks City-Base, TX: Performance Enhancement Research Division. 2006.

Van Der Hart, O.; Nijenhuis, E. & Steele, K. (2006) The Haunted Self, Structural Dissociation and the Treatment of Chronic Traumatization, WW Norton & Co